Haber: Ahmet Çağatay Bayraktar

Yapay zeka ve derin öğrenme günlük hayatımızdaki birçok detayda yer almaya başladı. Derin öğrenme akıllı telefonlardaki uygulamalardan, yarı otonom arabalara kadar insan hayatını kolaylaştırdığı gibi birçok sahteciliğe de kapı aralayarak kitlelerin manipüle edilmesini sağlayabiliyor.

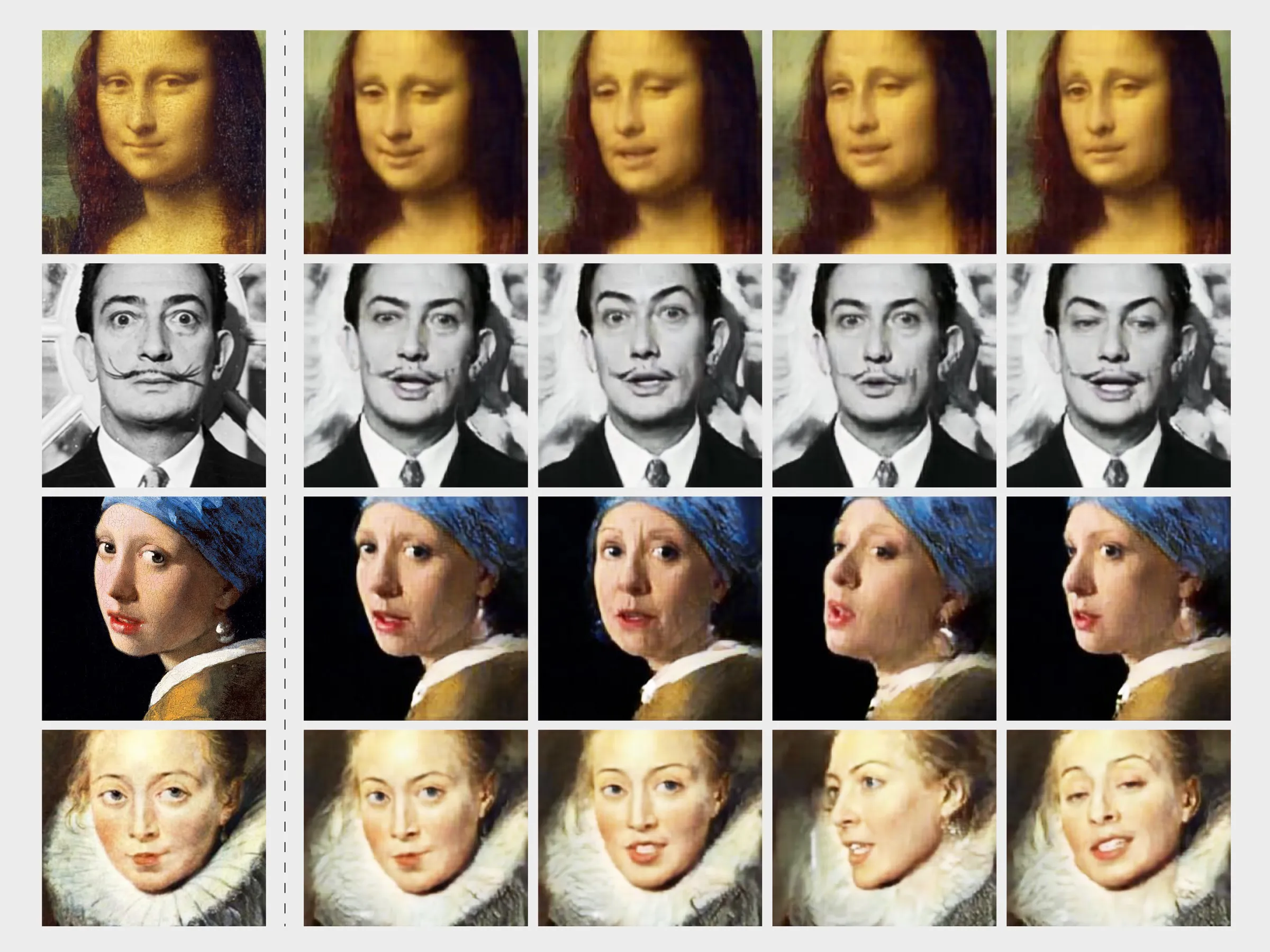

Adını deep learning(derin öğrenme) ve fake (sahte) kelimelerinin birleşiminden alan deepfake teknolojisi ise mevcut bir görüntü veya videoda yer alan bir kişinin yapay zeka yardımıyla başka birinin görüntüsü ile değiştirildiği bir medya türü. Çeşitli algoritmaların kullanıldığı deepfake ile gerçek bir kişinin yüzünün yanı sıra ses sentezleme teknikleri kullanılarak, kişinin konuşması taklit edilebiliyor. Bunun son örneği ise eski ABD Başkanı Trump’ın tutuklandığına dair deepfake ile üretilmiş görüntüler oldu. Görüntülerin gerçekçiliğinin yanında sosyal medyada hızla yayılması da deepfake’in toplumdaki etki gücünü ve yasal çerçevesinin sorgulanmasına yol açtı.

Geçtiğimiz günlerde Papa Francis'in deepfake ile hazırlanan fotoğrafları da gündem olmuştu

Deepfake’in kötü niyetli kişiler tarafından manipülasyon amacıyla kullanılabileceğini belirten Avukat Adem Akkır, Türkiye’de deepfake videolarının oluşturulmasında yasal bir engel bulunmadığını belirterek şunları söyledi: “Bu tür görüntü ve videoların kullanım amaçlarına göre değerlendirme yapmak gerekiyor. Teknik olarak deepfake videolarının illegal olmadığını söylemek gerekir. Ama Türk Medeni Kanunu’nun kişiliğin korunmasına ilişkin hükümlerini ihlal eden içerikler hakkında yargıya müracaat edilebilir. Ayrıca bu içerikler yüzünden zarara uğrayan kişi yine Türk Borçlar Kanunu haksız fiil hükümlerinden faydalanabilir. Kişisel Verileri Koruma Kanunu yine koruma sağlayabilir, Fikir ve Sanat Eserleri Kanunu, 5651 sayılı İnternet ortamında yapılan yayınların düzenlenmesine ve bu yayın yoluyla işlenen suçlarla mücadele edilmesi hakkında kanun ve Türk Ceza Kanunu, kişilik haklarını koruma altında bulunuyor. Kanuna göre kişilik hakkına açık saldırı niteliği taşıyan bu içeriğin çıkartılmasını içerik sağlayıcısına, buna ulaşamaması hâlinde yer sağlayıcısına başvurarak uyarı yöntemi ile içeriğin yayından çıkarılmasını isteyebileceği gibi doğrudan sulh ceza hâkimine başvurarak içerik veyahut yer sağlayıcı ve yine sosyal ağ sağlayıcısı aracılığıyla sunulan içeriğe erişimin engellenmesi de istenebilir. Sahte içerik aracılığıyla kişilik hakkına yapılan bu saldırı nedeniyle savcılığa suç duyurusunda bulunularak bu kişilerin cezalandırılması da talep edilebilir.”

İçerikler yayılmadan engellenmeli

Deepfake ile üretilen içeriklerin internet üzerinde yayılmadan önlenmesi gerektiğini vurgulayan Akkır, “Yargı yolu ile aranan hukuki çareler daha çok yaşanan fiili bertaraf etmeye veya doğurduğu zararları tazmin etmeye yönelik olmaktadır. Oysa ki bu yolla mağdura tam bir tatmin yaşatmak da mümkün değil işte bu nedenle bu teknolojinin yaratacağı zararları azaltacak önleyici tedbirleri almak daha önemli. Yapay zeka veya benzeri teknolojiler kullanılarak bu içeriklerin yer sağlayıcılar veya sosyal ağ sağlayıcılar tarafından yayınlanmadan engellenmesi bu açıdan etkili olur. Mücadelede iş birliği için standartlar oluşturulması da zararlı içeriklerin üretilmesini engeller. Örneğin, deepfake teknolojisini kullanan veya üreten şirketler, akademisyenler, sivil toplum kuruluşları ve devlet kurumları arasında iletişimi ve iyileştirmeyi sağlayan bir ortak platform kurulabilir. Deepfake teknolojisinin etik ve yasal çerçevesi belirlenebilir, sektörel standartlar oluşturulabilir ve denetim mekanizmaları geliştirilebilir” şeklinde konuştu.

Yüzde 100 tespit edilemiyor

Yapay zekanın devamlı olarak geliştiğine dikkat çeken İstanbul Üniversitesi İletişim Fakültesi Arş. Gör. Betül Yüncüoğlu, deepfake’in gelişmesinin yanında deepfake tespit teknolojilerinin de geliştiğini söyledi: “İki aşamada da yapay zeka destekli ve çeşitli veri setlerine dayalı olduğu için üretim geliştikçe tespit, tespit geliştikçe de üretim gelişiyor. Deepfake, basit telefon uygulamaları aracılığıyla birkaç fotoğraf verisi ile üretilebildiği gibi çok daha profesyonel yazılımlar aracılığı ile zengin veri setleri ile de yapılabiliyor. Ancak bütün görüntüler inandırıcı olmadığı gibi bütün tespitler de yüzde 100 başarılı şekilde çalışacak seviyeye gelmedi.”

Sahte içeriği anlamanın yolları neler?

Bazı sahte görüntülerin kolayca fark edilebileceğini söyleyen Yüncüoğlu, “Eğer çok profesyonel bir şekilde hazırlanmış bir deepfake değilse bir görüntünün gerçek olup olmadığını anlamanın en kolay yolu görüntüdeki kişinin gözleridir. Gözlerin hareketi, bakışı, gözlerdeki ışık yansımaları, gözlük varsa gözlükteki ışık yansımaları görüntü hakkında bazı ip uçları verebilir. Deepfake üretim sürecindeki en zorlu kısım da gözlerdir. Bunun dışında mimikler de oldukça ayırt edici olabilir. Gülüş, kaş çatma, dişler, kafanın sağa ve sola doğru çevrilmesi görüntünün doğal olmadığının belirtileri arasında yer alabilir. Ancak günün sonunda bu günümüz teknolojisinin verdiği imkanlar için geçerlidir. İlerleyen dönemlerde daha kusursuz deepfake görüntüleri karşımıza çıkabilir. Elbette tespiti için de yeni yöntemler görebiliriz” şeklinde konuştu.

Sinemanın gelişmesine katkı sağlıyor

“Sinema sektörü için oldukça önemli bir gelişme olarak görülebilir” diyen Yüncüoğlu, “Birçok zor sahnenin çekiminde, hayatta olmayan sanatçıların yeni yapımlarda yer almasında, oyuncuların role göre daha genç ya da daha yaşlı gösterilmesinde kullanılabilir. Aynı zamanda yüksek maliyetli sahnelerin çok daha ekonomik şekilde çekilmesine de yardımcı olabilir. Bunun örneklerini hem sinema filmlerinde hem de reklam filmlerinde gördük. Günümüzde en çok “eğlence” amaçlı kullanılan deepfake teknolojisi, bu konuda da çeşitli şekillerde karşımıza çıkabiliyor. Örneğin vefat eden tanıdıklarımızın fotoğraflarını yükleyerek sanki o kişiler yaşıyormuş gibi yeni görüntülerini üretmek mümkün. Yapay zekâ araçlarının artması ile birkaç fotoğraf girdisi kullanarak oldukça fazla görüntü elde etmek mümkün” dedi.

Deepfake toplumsal sorunları tetikleyebilir

“Deepfake’in olumsuz sonuçları yıkıcı ve büyük olabilir” diyen Yüncüoğlu, “Deepfake’in bir zorbalık ve cinsel taciz yöntemi olarak kullanıldığı birçok vaka görüldü. Deepfake’in ortaya çıkışı zaten 2017 yılında Reddit adlı platformdaki bir kullanıcının Hollywood’ta bilinen ünlü kadın oyuncuların yüzlerinin çeşitli pornografik görüntülere yerleştirmesiyle gerçekleşti. Özellikle Amerika’da birçok kadının videoları gerçekmiş gibi paylaşıldı ve bu yüzden azımsanmayacak sayıda kadın zarar gördü. Bir diğer yıkıcı boyut ise toplumsal olaylarda ve siyasette beklenmektedir. Özellikle siyasi liderlerin deepfake videolarının çıkması toplumda oldukça yanıltıcı sonuçlar doğurabilir. Post-truth yani gerçek ötesi olarak adlandırılan bu dönemde gerçeğin ve sahtenin ayrımının oldukça zor olduğu bir dönemde yaşıyoruz. Bir sahte video yayıldıktan sonra o videonun sahte olduğu ortaya çıksa bile bu düzeltme, ilk videoyu izleyen insanların hepsine ulaşmayabilir. Bu da toplumsal sorunları tetikleyebilir” şeklinde konuştu.

Deepfake ile üretilen sahte içeriklerin bireylerin gerçeklik algısını bozabileceğini vurgulayan Yüncüoğlu, “Sağlık sebepleri ile bir süre kamuoyundan uzak kalan Gabon Başkanı Ali Bongo kendisinin öldüğüne dair olan dedikodulara son vermek amacıyla bir video yayınlar ancak bu videodan sonra halk Bongo’nun öldüğüne daha da emin olur ve ordu bir darbe girişiminde bulunur. Videonun sahte olduğunun düşünülmesinin sebebi ise Bongo’nun gözleri ve mimiklerinin oldukça yapay görünmesi ve deepfake sanılmasıydı. Bir başka örnekse ABD’de 2020 yılında düzenlenen seçimlerde Facebook’un bu tür videolarının paylaşımını yasaklaması, aynı şekilde Kaliforniya Valiliği’nin de seçim süreci boyunca deepfake paylaşımını yasaklaması oldu” diye ekledi.